��˾����

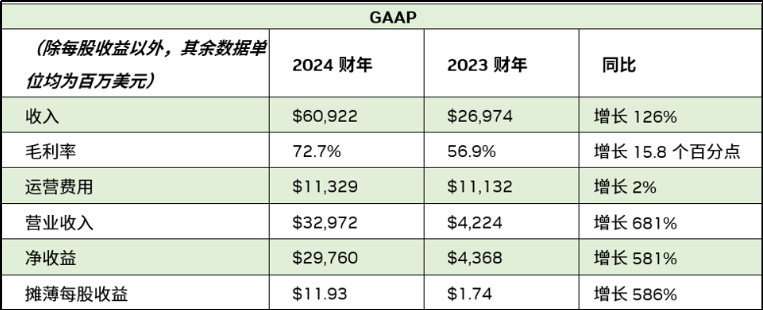

Ӣΰ����ȫ��AI������ͷ��������1993�꣬רע��GPU���з������죬���ɴ�ͳGPU��Ӧ��ת������Ϊƽ̨����ҵ����Ϊ�˹�����ʱ����Ӳ��һ�廯AI ��������쵼�ߡ�Ӣΰ��2023��ȫ��ʵ��Ӫ��609.2����Ԫ��ͬ������126%��ë���ʸߴ�72.7%��ͬ������15.8%����������Ϊ297.6����Ԫ��ͬ������581%�������У���������ҵ��������Ҫ������Դ��2023ȫ��ʵ������475����Ԫ��ͬ������217%������2024��6�³���Ӣΰ����ֵͻ��3������Ԫ����Ϊ������ֵ�ڶ�����ҵ��

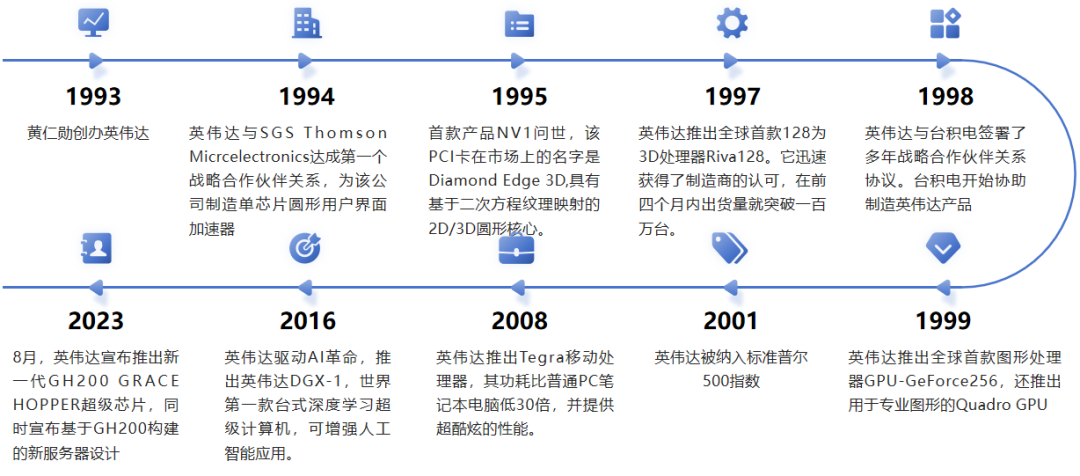

ͼ1 Ӣΰ��ķ�չ����

��1 Ӣΰ��2023-2024�����ؼ�ҵ��ָ��

��������Ʒ�����

1. ������ע��������ƣ�������������

��1��оƬ��������ϼ���

Ӣΰ��ĺ��������Ƽ���������die-to-die link����Ƭ����Ƭ���ӣ���Grace CPU��NVLink��NVSwitch���������˴Ӿ�Բ��wafer��оƬ��ӡ�Ƶ�·�壨pcb��������͵�������ȫ�߶Ȼ���������

Ӣΰ���ͨ�˼��������Σ���������Ʒֳ����������Σ�������ÿһ����ζ��ﵽ��Ѽ���Ҫ�������ֱ��ǣ���оƬ��Die-to-DielinkһƬ˫о��NVLink�������NVSwitch SuperPOD�����㣩��AI����������

��2��GPU�ܹ�

Ӣΰ�ﲻ���Ƴ��µ�GPU�ܹ�����Ampere��Turing��Hopper�ȣ���Щ�ܹ���Ӳ������Ͻ����˶���¡�����Ampere�ܹ���Nvidia GPU���¼����Ļ�ʯ�������и��ߵ����ܡ����͵Ĺ��ĺ�ǿ��AI����������

Ampere�ܹ��ĺ��ļ���������

������Tensor Core��Ampere�ܹ��еĵ�����Tensor Core���и��ߵĸ����������ܺ�ǿ�ľ���˷��������ܹ�����AIģ�͵ĸ��Ӽ�������

�ڶ���RT Core��Ampere�ܹ��еĵڶ���RT Core���и��ߵĹ��������ܺ�ǿ��ʵʱ�����������ܹ��ṩ���ӱ����ͼ����ȾЧ����

�µ�SM�ܹ���Ampere�ܹ��е��µ�SM��Streaming Multiprocessor�������������ܹ����и��ߵIJ��д���������ǿ�����ݴ����������ܹ�������ģ���ݴ���������

��3��ͼ����Ⱦ����

һ��AI Agent��ͼ����Ⱦ����DLSS��Deep Learning Super Sampling�����ѧϰ������������Nvidia����Ampere�ܹ�������һ������Լ�����DLSS����ʹ��AI Agent��ʵʱ���ɸ�������ͼ�Σ��ܹ��ṩ���ӱ����ͼ����ȾЧ�����ߵ�֡�ʡ�

����Nvidia GPU�Ĺ����ټ���(Ray Tracing)������Nvidia����Ampere�ܹ�������һ������Լ�����Ray Tracing����ʹ�ù������㷨��ģ����ʵ�����еĹ���Ч�����ܹ��ṩ���ӱ����ͼ����ȾЧ�����ߵ�ͼ��������

������Ӱ��Ⱦ������Variable Rate Shading�����ü�����Nvidia����Ampere�ܹ�������һ������Լ�����Variable Rate Shading����ʹ�ÿɱ�����Ӱ��Ⱦ�㷨��ģ����ʵ�����е���ӰЧ�����ܹ��ṩ���ӱ����ͼ����ȾЧ�����ߵ�ͼ��������

��4��AI���ټ��㼼��

Nvidia GPU��AI���ټ��㼼����AI Acceleration���������¼����ĺ�����ɲ��֡�Nvidia GPU��AI����������������AIģ�͵ĸ��Ӽ��������ṩ���ٵ�AI�������ܺ͵��ӳٵ����ݴ�����������������һ��Tensor Core����ר��ΪAI������ƵĴ�������Ԫ���ܹ��ṩ���ٵĸ����������ܺ;���˷��������ڶ���CUDA���ģ���ר��Ϊ���м�����ƵĴ�������Ԫ���ܹ��ṩ���ٵIJ��д������ܺ����ݴ���������

2. ��Ʒ���˵��ˡ�ѵ������һ�塢����ȫջ

Ŀǰ��AI����Ӣΰ���ҵ����ӣ��˵��ˡ�ѵ������һ�塢����ȫջ��ҵ��˼·����ز�Ʒ�������ϣ���Ҫ����AIоƬ��ѵ���������������磨оƬ�������豸�������������������&Ӧ�������ȡ�

AI оƬ��Ӣΰ��ÿ��1-2������µ�оƬ�ܹ�����Ӧ����������������AIоƬ���ֺ�����ѵ�������������˹����ܹؼ�Ӧ�ã�ѵ�������ںϣ���������������AIоƬ�滮��ս�Ժ�����“One Architecture”ͳһ�ܹ���֧�����κεط�����ģ��ѵ���Ͳ���

����оƬ��ϣ�Ӣΰ�����������������ṩһ�廯��оƬ���������CPU+GPU+DPU �IJ�Ʒ��ϣ�����Ӣΰ�������硢���������ͻ�����ƣ�������һ��ǿ��Ӣΰ������������HPC����ľ������ơ�

����ģ��Nemo��ͨ��100+��鸳��ǧ�а�ҵ������NeMo�����Խ����ض������������������ר�ң����������ֳ�������������ɵػش�ͻ����⣬���ṩȷ�����µ���Ϣ�ȡ�

3. ����

��1���Ƽ������

2022�꿪ʼ��Ӣΰ�������Լ���AIӲ�������������λ��������Ӣΰ���Ʒ������루DGX Cloud����Ӣΰ��ϣ��ͨ�������г��Ʒ���������Ӣΰ��֧�ֵķ�������Ӣΰ���ٰ���ͬ�ķ�������� AI ���������̣��Ի�ȡ�Ƽ������롣AI������˾Ҳ��ʼ�� CoreWeave �� GPU�Ƴ�����˾�������������������Ǵ�AWS�����ƹ�˾�������ޡ�����һЩ����ƹ�˾��Ҳ����Ӣΰ���ɺ�����ϵ��GPU�Ƴ�����˾������ GPU ��������

Ӣΰ����ƿͻ��ɷ�Ϊ�������ͣ�������С���ƹ�˾��coreWeave��AI ������˾��Cohere��Inflection AI��Aleph Alpha�ȣ����������IT ������ͷ��˾ ServiceNow��������ҩ��˾ Amgen �����չ�˾ CCC Intelligence Solutions�ȡ�

��2����ԭ��AI����

2024�꣬Ӣΰ���Ƴ�����ʽAI�������������Ѱ�װCUDA GPU��ϵͳ�д����Ͳ�������ʽAI���֡���ҵ����������Щ�������Լ���ƽ̨�ϴ����Ͳ�����Ӧ�ã�ͬʱ������֪ʶ��Ȩ����������Ȩ�Ϳ���Ȩ��

NVIDIA CUDA ƽ̨�ϵ���ԭ��������� NVIDIA NIM ���������� NVIDIA �����������̬ϵͳ�� 20 ������ŵ� AI ģ�ͽ��������Ż����û��ܹ���SageMaker���ȸ�KubernetesEngine����AzureAI�з���NIM������Deepset��LangChain��LlamaIndex�����е�AI��ܼ��ɣ�������NVIDIA CUDA-X�������ʽʹ��NVIDIA��������������������ߣ����ڼ�����ǿ���ɣ�RAG�������������ݴ�����HPC�ȡ�

Ŀǰ���� Adobe��Cadence��CrowdStrike��Getty Images��SAP��ServiceNow �� Shutterstock ���ڵ��������Ӧ�á����ݺ����簲ȫƽ̨�ṩ���Ѿ�����ʹ���� NVIDIA AI Enterprise 5.0 ������ʽ AI����

�г���չ����

Ӣΰ��ͨ�����ϴ��º��Ƴ��Ƚ��IJ�Ʒ�ͷ����Ѿ���Ϊȫ��AI����������ߣ����ڶ���߿Ƽ��������ȵ�λ��Ӣΰ������������GPU�г�ռ�м��ߵķݶ2023��������ﵽ376��̨���г�ռ�ȸߴ�98%��Ӣΰ��ͨ����ǿ����&ͨ������+CUDA��̬+DGX Cloud AI�Ʒ���ͬ��������Ļ��Ǻӣ����Ʒ�ƶ���ȫ��AI��HPC����Ϸ��������ơ��Զ���ʻ�����ͻ����˿�������Ľ�����

�ھ����г���չ�����ϣ�Ӣΰ���ȡ���´�ʩ��

һ��ͨ����NVIDIA LaunchPad�ƻ��������Ƿ�Χ������ȫ��9��������������ҵ���ٿ����Ͳ���AIӦ�á����⣬Ӣΰ��Ҳ��ŷ�����Ű�ͼ����Ϊŷ����ҵ�����dz��ʺ���ҵ��չ��Ӣΰ�ﻹ�ڻ��������й��г����ƶ��й��Ʒ���ҵ��ķ�չ��

����Ӣΰ��ͨ���з�Ͷ��ͼ������²����Ƴ���һ��GPU������Ӳ����Ʒ��ͨ��Ӳ���������Ľ�ϣ��ṩ��Բ�ͬϸ�������ϵͳ���������Ʒ�������г����ȵ�λ�����磬DGX�����������ģ�HGX���ڳ����ģ�������ġ����ּ������ºͲ�Ʒ������ʹӢΰ���ܹ���AI�������ȵ�λ����Լ��ҵ��г�������Ӣΰ��ͨ�����������г���λ��

����Ӣΰ��ͨ������ۼ��������г���������Ⱦ����ͼ۸�ս���Ӷ�������˾��ӯ��������ͬʱ��Ӣΰ��Ҳ������г�������м۸����������������ͻ��Ϳ�����ʹ����оƬ��Ʒ��

����ͨ�������ҵ�ĺ�����ϵ���ƶ�AI�����Ĺ㷺Ӧ�á����磬������ĺ���ּ���û�������ҵ�����Լ����˹������������Ӷ��̼������Ʒ�������⣬Ӣΰ�ﻹ�������Ƶȹ�˾��������һ����չAI PC�г���

����ͨ����Ԫ����Ͷ�ʲ��ԣ�������չ����ҵ��Χ������ǿ�������ҵ�ĺ�����ϵ������Ͷ�ʲ���������Ӣΰ����ȫ��Χ����չҵ��

���Dz���̽���µ��г����ᣬ�����ٴν�����Ϸ�ƻ��г��ȡ�

��֯����Ӫ

�ֲ�ʽ����ϵͳ����֯�ܹ���Ӣΰ�ォ��������GPU��������ǿ��ÿ����Ԫ��������������Эͬ��ͨ���ֲ�ʽ�Ĺ�ͨ����֯�ܹ���ʵ����Ϣ�Ĺ㷺�ֲ����Ч��������֤��֯������Ժ�Ч�ʡ�

�Ե�н����ϵ��Ӣΰ��ʵ��һ�־�ȷ�ȼ��ߵ�н�������ƣ�ȷ��ÿ����Ա��н����켫С��ּ�ڼ����ڲ��ȼ��У��ٽ��ŶӺ�����

ֱ�ӻ㱨��ϵ�����ñ�ƽ�������ṹ�������м�㼶��CEO����ѫֱ�ӹ����ӽ�50�����ܼ������ܾ��������������������Ӫ4�ˣ�����2�ˣ�����9�ˣ�������ҵ1�ˣ�����3�ˣ���Ӫ4�ˣ����ҵ��2�ˣ�������1�ˣ���̬ϵͳ4�ˣ��ն��û�����7�ˣ�������Դ5�ˣ���������Դ���á�ȫ����ļ������ҵ��ý2�ˣ���Ե����1�ˡ������㱨��ϵ����Ч�ʺ����ȣ�ǿ����Ϣ�������ǿ��ơ�

Ӣΰ�ﳣ��רעͶ���з����з����ô��ڸ�λˮƽ������������Ӣΰ��ͨ��“���Ŷ�-������”���з�ģʽ�Լ��۽�GPU�з���ʵ�����ڵ�һ������������ȸ��ߵ��з�Ͷ�롣����AMD��ȣ�2005��Ӣΰ���з�Ͷ��ΪAMD��32.73%����2023�꣬Ӣΰ���з�Ͷ������AMD��1.47����

ͨ����Ч���������ۼ����������������½���Ӣΰ�������������۷����ʴ�10%���½���2023�꣬Ӣΰ�����ۼ������������½���4.36%��

�ʱ�����

Ӣΰ�ﲻ����оƬ�з���Ͷ�����AI������˾��Ͷ�ʷ�����ַdz���Ծ����ЩͶ�ʸ���AI������ʩ��AI��ֱӦ���Լ�����ʽAI�ȶ������ΪӢΰ��������µ�������ͼ���Эͬ��

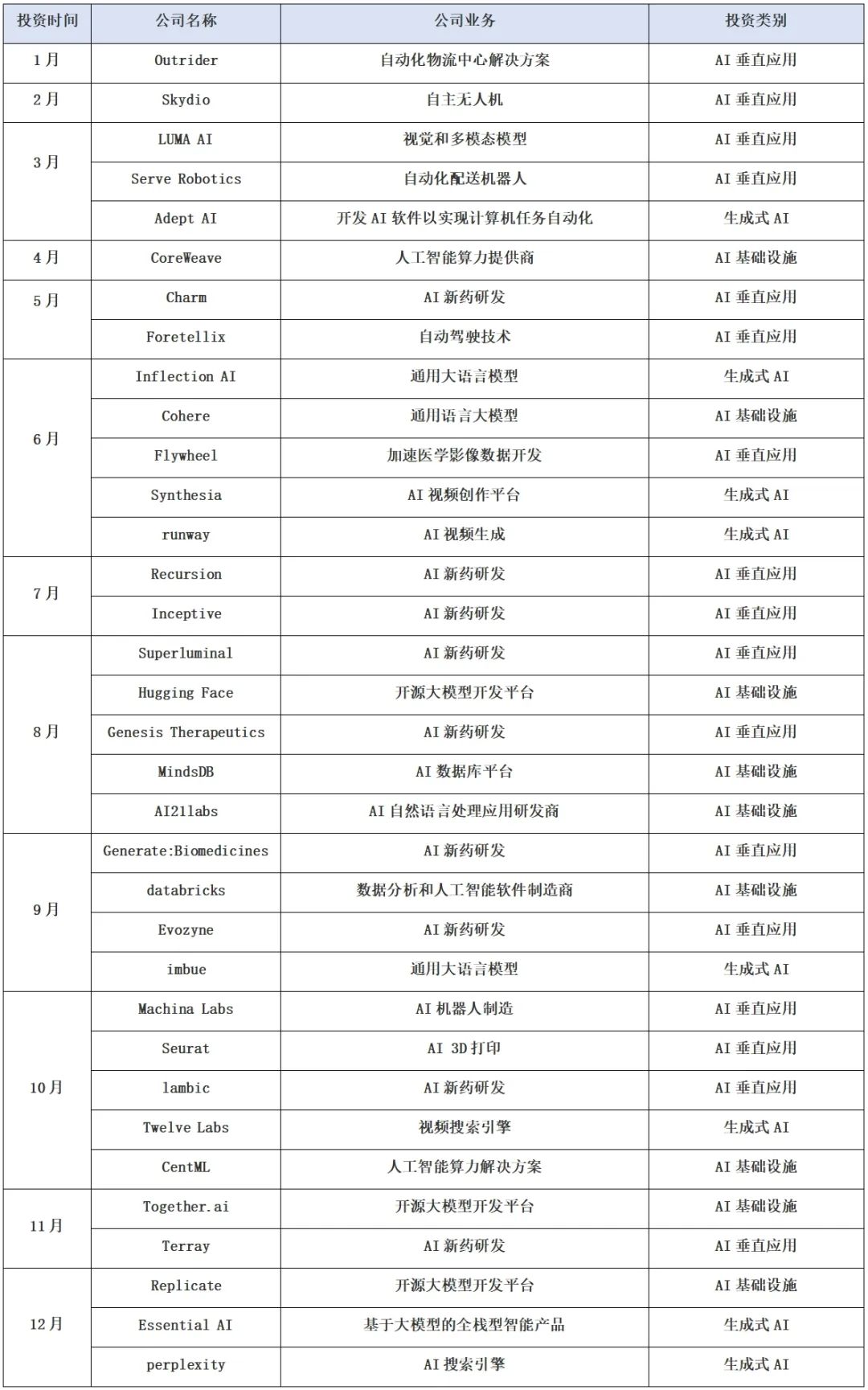

2023��Ӣΰ��ͨ�����Ͷ����NventuresͶ����34����AI��صĹ�˾.��һ������2022���3���ࡣ������ʽAI���棬Ӣΰ��Ͷ�����������桢��Ƶ�������ɡ��˹����ܴ���������Ĺ�˾����AI��ֱӦ�÷��棬Ӣΰ��Ͷ����10��ҽҩ��ع�˾�����磬Ӣΰ����2023��8��Ͷ���˿�Դ��ģ�Ϳ���ƽ̨Hugging Face������9��Ͷ�������ݷ������˹���������������Databricks�����⣬Ӣΰ�ﻹͶ���˰���AI������˾Mistral���ù�˾��ֵ�ﵽ20��ŷԪ��

������2 Ӣΰ��2023��Ͷ�ʵ�34�ҳ�����˾

2024�꣬Ӣΰ������Ӵ��AI������˾��Ͷ�����ȡ��ݱ�����Ӣΰ��ͨ����Ͷ����Ͷ���ܶ��15����Ԫ���ص�Ͷ��δ��ʮ����¼�������ЩͶ�ʲ�������������ʽAI��AI������ʩ��AI��ֱӦ�ã����������������������\�����Զ���ʻ�ȡ�

Ӣΰ���Ͷ��һ����ּ��ǿ����̬ϵͳ��ͨ����������ƽ̨�߶���صĴ���������չ��̬ϵͳ�����ֲ���������Ӣΰ�ﹹ��һ�����ӽ��ܺͻ����ĺ���������磬�Ӷ���һ����������AI������쵼��λ����һ����ּ�ڻ�ò���ر���Ӣΰ���ر�����AI����Ķ��������˾����Cohere�ȡ�

Ӣΰ����Ͷ��AI������˾ʱ����Ҫ�������¼����������أ�

һ��ҵ������ԣ�Ӣΰ��dz�����Ͷ����Ŀ�������ҵ�������ԡ�NVentures��������ָ������Ӣΰ����˵��Ͷ�ʳ�����ҵ����Ҫ��������ԡ�

���Ǽ���ʵ�����г�ǰ����Ӣΰ�������Ŀ�깫˾�ļ���ʵ�����г�ǰ������ȷ����Ͷ���ܹ��������ڵĻر���������Բ�Ʒ���ܡ����ĺͻ������ܵȷ���Ŀ�����

����ע�ؾ�����ҵӦ������Ӣΰ�����Ȥ��Ͷ�����������������ҩ��ҽ�Ʊ����ȣ���Щ�������������ļ������ƺ��г�����߶���ء�

���Ǻ���DZ������Ӣΰ��ͨ��Ͷ��AI��������CoreWeave����ͨ����ѺH100 GPU�õ�������Թ������Ӣΰ���GPU���γ���һ������ѭ�����ȼ�ǿ��������Ʒ���г������ִٽ���Ŀ�깫˾�ķ�չ��

����Ŀ�깫˾��ֵ��Ӣΰ��һ��ֻ����С��Ͷ�ʣ�ֻ�ڸ�������½��д��Ͷ�ʣ�����10����Ԫ�չ�����ά��AI������˾Run:ai����Ϊ����һ���Ѿ��ɹ��������ȫ��500ǿ��ҵ�Ż� AIӲ��������ʩ�Ĺ�˾��ӵ���ȶ��Ŀͻ�Ⱥ�����롣

��̬����

Ӣΰ�NVIDIA����ȫ��Χ�����ҹ�˾�����˺�����ϵ���������˹����ܡ��뵼�����졢�������Ƽ���ȶ�������ͺ�����������

��1���˹����ܺͰ뵼������

̨���磺��Ӣΰ�����ʹ�ü�����ƽ̨���ӿ���һ���Ƚ��뵼��оƬ�������ٶȲ��˷��������ơ�

Synopsys����˼�Ƽ�����������������ʹ��Ӣΰ�������ƽ̨��

���뼯�ţ������Ƴ�ȫ�»���˹����ܽ��������

��2��������ҵ��

�ݱ�·�������ǵϵȣ���Ӣΰ�ィ������ս�Ժ�����ϵ����ͬ��������һ���Զ���ʻϵͳ���з���

��3���Ƽ����HPC�������ܼ��㣩��

�ȸ��ƣ���Ӣΰ�������������ϵ���ƽ�AI���㡢�����ͷ���ķ�չ��

����ѷAWS��������AWS Graviton2��Amazon EC2ʵ����NVIDIA GPU���ϣ�������ѧ��AIӦ�õĿ�����

��4����Ϸ���Կ������̣�

������˶��ASUS�����곞��Acer�������գ�HP�������루Lenovo������Щ��˾������Ӣΰ���GPU���ṩ���ֶ��ƽ������������Ϸ�Կ���רҵͼ�ι���վ���������ķ������ȡ�

��5���Ʒ����̡���ģ���̣�

OpenAI������Meta�����������ģ���Щ��˾��Ӣΰ���н��ܵĺ�����ϵ����ͬ�ƶ�AI�����ķ�չ��

Hugging Face����Ӣΰ�ィ����������ϵ���ÿ�����Ա������Nvidia DGX Cloud�������������ʩ�Ͻ��л���ѧϰ��AI���߿�����

��6��������ҵ��

���⣬Ӣΰ�ﻹͨ����NVIDIA Partner Network (NPN)��ȫ����صĺ��������к�������Щ������鰴���������ͽ��л��֡�

ǰհ�����ƶ���վ����ָ��Ե���㣺Ӣΰ����������Ż�����ʩ�����߰����ž�һ�����оƬ���Ӣΰ���ͼ�δ�����Ԫ��GPU������������оƬ����̸�У�ͬʱ������Ӣΰ�ォ���ϳ���һ���µ���ҵЭ��“AI-RAN ����”�����ž�ͷ�����š�ŵ���ǵ�ȫ��Լ 10 �ҹ�˾Ҳ���μ����У������ڽ������ƶ�ͨ�Ż�վ��ɢ AI �����ļ���ʵ�û���

��ͬ�����Ƚ�AIģ�ͣ�Ӣΰ���OpenAI��չ�����ǵĺ�������ϵ����ͬ������һ����ChatGPT��ǿ����Ƚ�AIģ�ͣ���ģ��������1000���Ӣΰ�� AI GPUs����һ������־����AI�����һ����ʱ���Ŀ�ʼ��ּ�����þ��˵ļ����������¶���AI�ı߽硣

����AI�о��뿪����Ӣΰ����ȸ��Ƶĺ�����չ����Ϊ����ѧϰ�����ṩ����֧�֣�ʹ�����ܹ������١����ɵع�������չ��������ʽAIӦ��������Ӣΰ����ȸ�ĺ����������Թȸ迪Դ��ģ��Gemma���Ż���ʹ��Ӣΰ��TensorRT-LLM�������������ڼ���AIģ�͵�ѵ�����������̡�

��������

���

ս�Է�չ�о���

��������ʦ

˶ʿ����ְ���й������о�Ժ��ս����Ӫ�о������ڴ��½��ڿƼ������������ѡ�����ҵ����о���

����

ս�Է�չ�о���

һ������ʦ

˶ʿ�����ڴ������ֲ�ҵ��չ�������о���������רע�����ֲ�ҵ���Ϲ���������ֳ���ҵ���о�������