C114讯 3月17日消息 作为新的科技界春晚,备受关注NVIDIA GTC 2026 在美国加州圣何塞 SAP 中心落下帷幕。

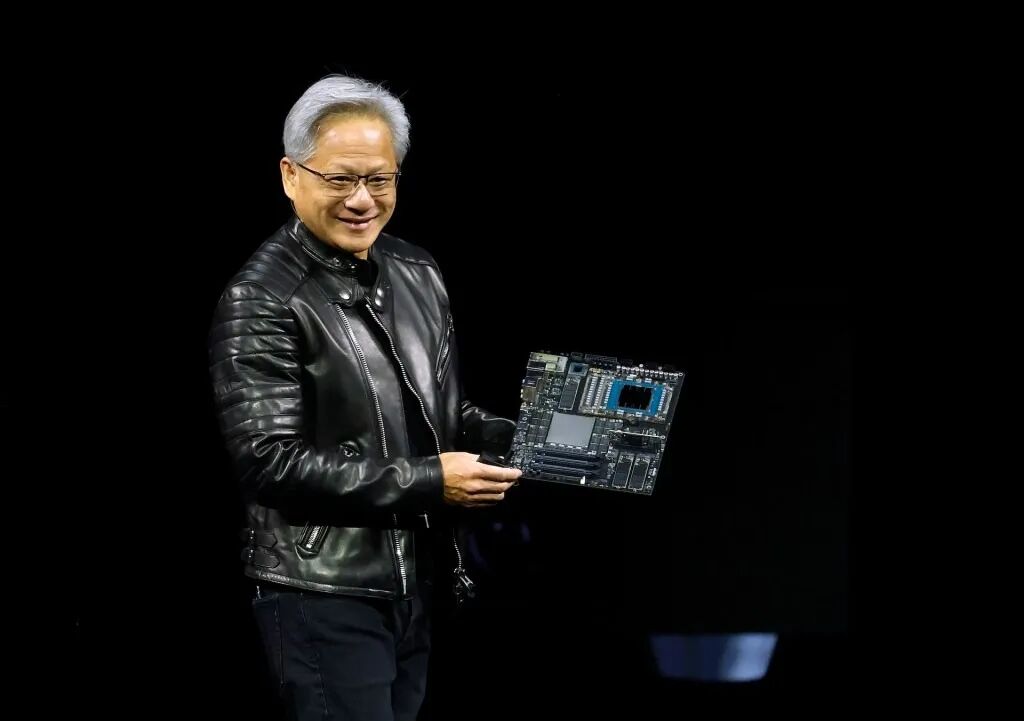

本届大会以AI 工业化基础设施为核心主题,英伟达创始人兼 CEO 黄仁勋在主题演讲中连发三代算力芯片、AI 工厂、开源智能体平台等重磅新品,覆盖算力基建、智能代理、物理 AI、自动驾驶、科学计算等全领域,宣布 AI 从模型竞赛迈入规模化落地的全新阶段。

三代算力芯片齐发,定义未来五年 AI 硬件

黄仁勋现场公布Feynman、Rubin、LPU三大芯片架构,形成 “未来旗舰 + 量产主力 + 推理专用” 的完整矩阵。

Feynman架构:全球首款面向世界模型与物理 AI的下一代 GPU,提前两年曝光原型。采用台积电 1.6nm A16 工艺,搭载硅光子光互连,带宽提升 10 倍、能耗降低 90%,推理性能为 Blackwell 的 5 倍,计划 2028 年量产。

Vera Rubin平台:Blackwell继任者,2026 年下半年量产。采用 3nm EUV 工艺与 HBM4 内存,单卡显存 288GB,推理成本较前代下降 10 倍,全面标配 CPO 共封装光学与全液冷,已获 OpenAI、DeepMind 等头部机构订单。

LPU推理专用芯片:整合收购而来的Groq 技术,主打超低延迟与高吞吐,首 Token 延迟低于 0.1ms,专为大规模 AI 代理与对话场景优化,显著提升多轮交互与复杂工具调用效率。

AI 工厂与全栈基建,重塑数据中心形态

大会正式提出AI 工厂理念,将数据中心从 “采购GPU” 升级为 “整柜交付的 AI 生产单元”。

推出 NVL72 液冷机架,单机柜功耗超 200kW,算力密度提升4倍;

发布 BlueField-4 STX 存储架构,面向长上下文推理优化,能效比传统架构高 4 倍;

全面普及 800V 高压直流供电、CPO光互联与高密度PCB,推动数据中心 PUE 降至1.1 以下。

软件生态开放,智能体与产业落地加速

NeMo Claw 开源智能体平台:企业级 AI 代理框架,支持本地部署、自主规划与多工具协同,开箱即用覆盖金融、制造、客服、研发等场景,让用户实现“一键养虾”,普惠全行业。

物理 AI 与具身智能:升级 Isaac Sim 与 Omniverse,强化机器人、自动驾驶、工业数字孪生能力。

产业合作:宣布与比亚迪、吉利、日产等车企合作 L4 级自动驾驶,联合 Uber 推进 2028 年落地 28 城 Robotaxi 车队。

黄仁勋在演讲中表示,AI 已成为每家企业、每个国家的核心基础设施,英伟达将以芯片、算力、软件、模型、应用五层全栈能力,推动 AI 在物理世界规模化落地。