5月8日,在2026移动云大会期间,中国移动研究院正式发布面向智算Scale-up卡间互联架构的商用级全向智感(OISA) IP Core,并在开放智算技术分论坛举办发布仪式,中国移动、中国电子、中电海康、之江实验室、百度等单位共同出席。作为国内领先的自主可控开放GPU卡间互联技术体系,OISA协议在经历2025年发布的V2.0版本及多次迭代后,目前已进入规模化商用阶段。本次商用IP Core的推出,标志着该协议从技术标准制定走向了产业落地,旨在为大规模智算集群提供标准化的底层互联支撑,并向全产业链开放集成,以应对智算时代对算力基础设施的更高要求。

当前,智算需求正从单点算力提升向超大规模集群演进,芯片间的互联瓶颈已成为制约算效提升的核心障碍。中国移动发挥产业链“链长”作用,以根技术创新引领产业发展,以OISA IP赋能智算产业发展。通过建立标准化的开放互联体系,该技术能够有效降低异构芯片间的兼容壁垒,减少芯片厂商在物理链路与协议开发上的投入,有助于在复杂多变的外部环境下保障国内智算产业供应链的稳定与安全。目前,OISA协同创新平台已汇聚超过50家产业链合作伙伴,涵盖了从标准制定、芯片设计、整机制造到终端运用的全生命周期,为构建高性能智算基础设施筑牢了技术底座。

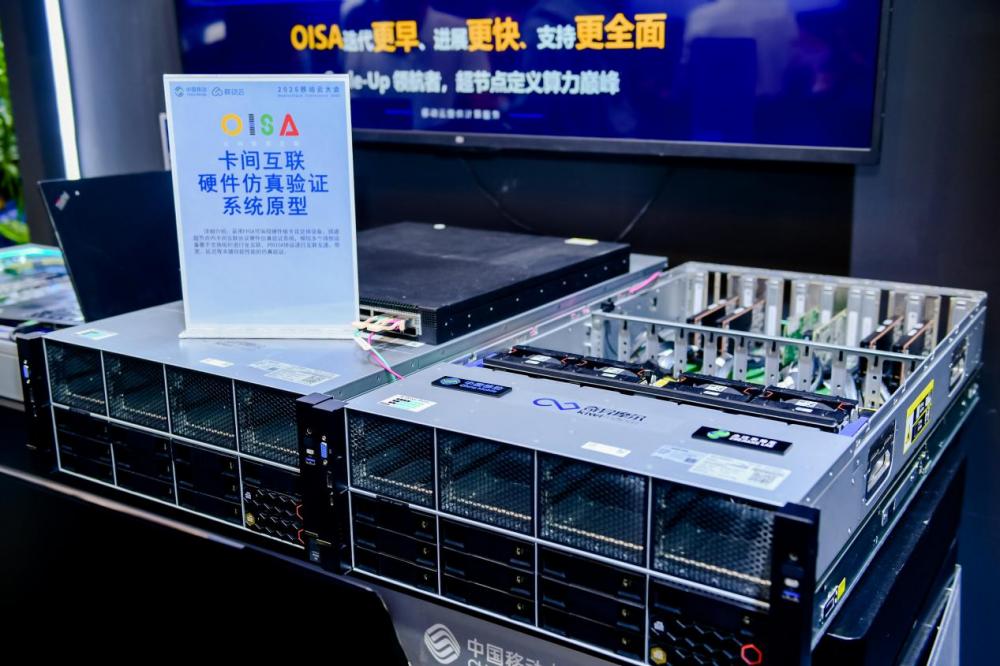

本次发布的OISA IP展示了针对超大规模算力集群深度优化的特征,从技术实现与实测性能来看,该IP支持百卡级单机柜全互联架构,超节点scall up 全互联规模高达1024张计算卡,构建起无阻塞的算力池。在互联表现上,OISA实现了TB/s级以上的卡间互联带宽,并原生支持内存语义,结合集合通信加速与动态报文聚合技术,使端到端通信时延缩短至百纳秒级。对比测试数据显示,相较于传统的协议方案,OISA在时延表现上实现了约1.7倍的性能优化。这种底层性能的跃升直接转化为业务层面的效率增益,以DeepSeek-V3模型在万卡级集群上的训练为例,采用OISA超节点方案后,模型算力利用率(MFU)提升了1.53倍,训练耗时缩短了3.59天。此外,同步发布的OISA仿真系统为多厂商芯片的兼容性适配提供了逻辑验证与性能评估环境,有效解决了芯片从设计到系统集成过程中的适配难题,加速了产品的商用化进程。

展望未来,中国移动将依托OISA协同创新平台与超节点创新联合体,持续推动互联技术向更高密度、更高能效的方向演进。随着支持OISA协议的多种芯片及高密超节点服务器产品的陆续面世,OISA将进一步深化与产业界的创新合作,驱动智算基础设施向集群化与标准化发展。通过持续的OISA技术共享与生态共建,在提升国产智算芯片能效比、实现降本增效的同时,为我国构建起一个更加开放、协同且具备长效竞争力的芯片互联技术生态。